文章速览01/LLM02/ChatGPTPrompt03/组合Agent04/Prompt微调05/总结06/参考文献LLM

大型语言模型是利用海量的文本数据进行训练海量的模型参数。大语言模型的使用,大体可以分为两个方向:

A.仅使用

B.微调后使用

仅使用又称Zero-shot,因为大语言模型具备大量通用的语料信息,量变可以产生质变。即使Zero-shot也许没得到用户想要的结果,但加上合适的prompt则可以进一步获取想要的知识。该基础目前被总结为promptlearning。

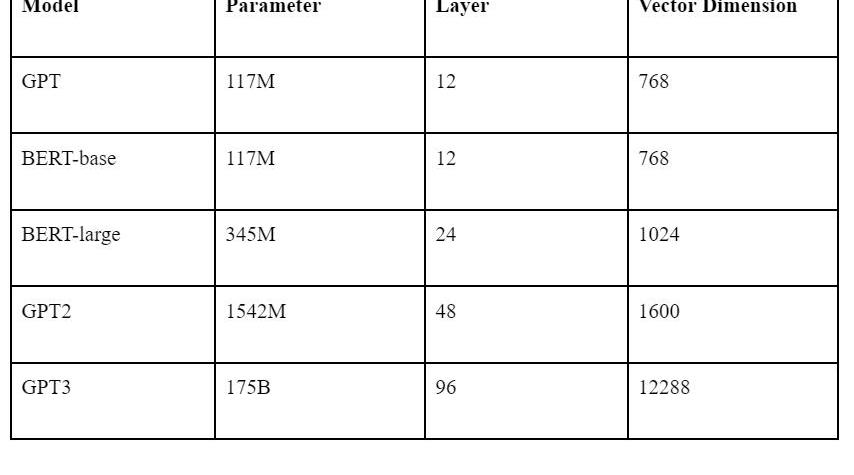

大语言模型,比较流行的就是BERT和GPT。从生态上讲BERT与GPT最大的区别就是前者模型开源,后者只开源了调用API,也就是目前的ChatGPT。

两个模型均是由若干层的Transformer组成,参数数量等信息如下表所示。

目前生态上讲,BERT多用于微调场景。因为微调必须在开源模型的基础上,GPT仅开源到GPT2的系列。且相同模型参数量下BERT在特定场景的效果往往高于GPT,微调需要调整全部的模型参数,所以从性价比而言,BERT比GPT更适合微调。

而GPT目前拥有ChatGPT这种面向广大人民群众的应用,使用简单。API的调用也尤其方便。所以若是仅使用LLM,则ChatGPT显然更有优势。

ChatGPTPrompt

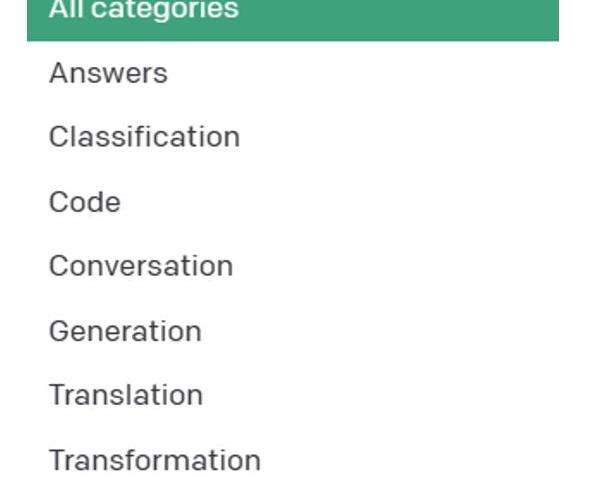

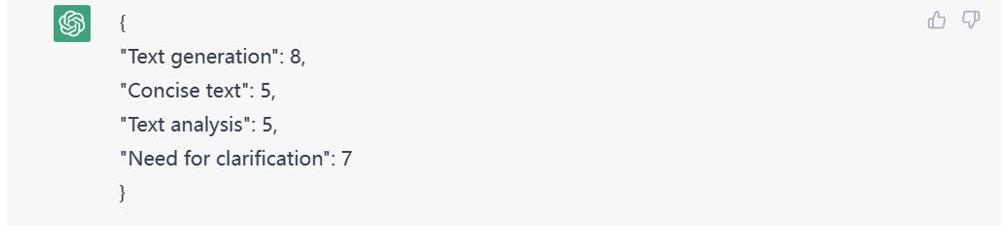

下图是OpenAI官方提出对于ChatGPT的prompt用法大类。

加密交易平台 Bitget 已完成立陶宛加密货币业务注册:4月20日消息,加密资产交易平台 Bitget 宣布已完成立陶宛加密货币业务注册。完成注册后,Bitget 可以在符合立陶宛法律法规的前提下,在该地区提供加密货币相关服务。Bitget 的合规团队人员在过去 12 个月增长了 50%,以支持在合规业务发展方面的计划和需求。同时 Bitget 也在积极构建完整的 Web3.0 生态,此前收购了超 950 万用户的多链钱包 BitKeep。香港区块链周期间也推出了 1 亿美元的 Bitget Web3 基金,以促进加密世界的发展,并将为有潜力的初创企业提供支持。[2023/4/20 14:16:17]

Figure1.PromptCategoriesbyOpenAI?

每种类别有很多具体的范例。如下图所示:

Figure2.PromptCategoriesExamplesbyOpenAI

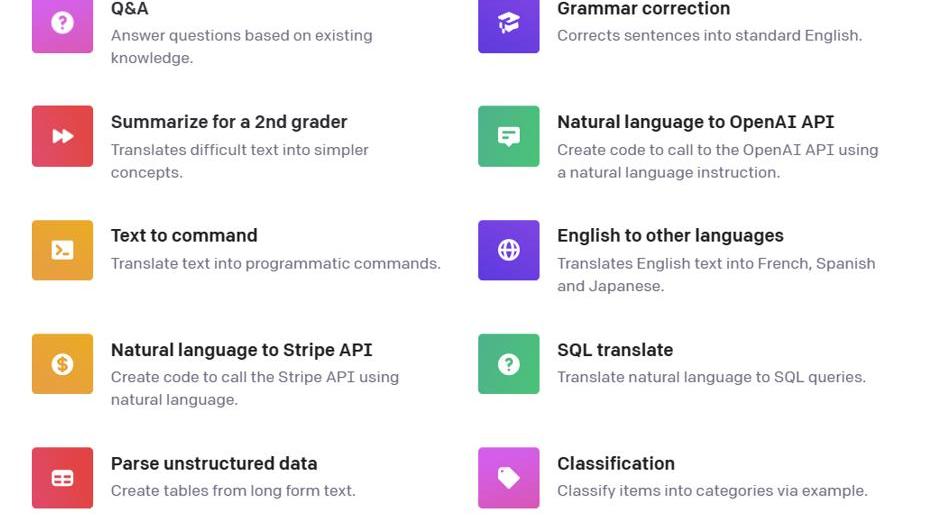

除此以外,我们在此提出一些略微高级的用法。

高级分类

这是一个意图识别的例子,本质上也是分类任务,我们指定了类别,让ChatGPT判断用户的意图在这

数据:一巨鲸解押7900万枚MATIC并转移到币安抛售致价格下降:11月28日消息,据Lookonchain监测,一巨鲸地址在11月15日解除质押了7900万枚MATIC(价值约6500万美元),然后陆续转移至币安,每次抛售都导致MATIC价格下跌。该地址目前仍持有3600万枚MATIC(约合2980万美元),可能会再次抛售。[2022/11/28 21:06:15]

Figure3.PromptExamples

实体识别与关系抽取

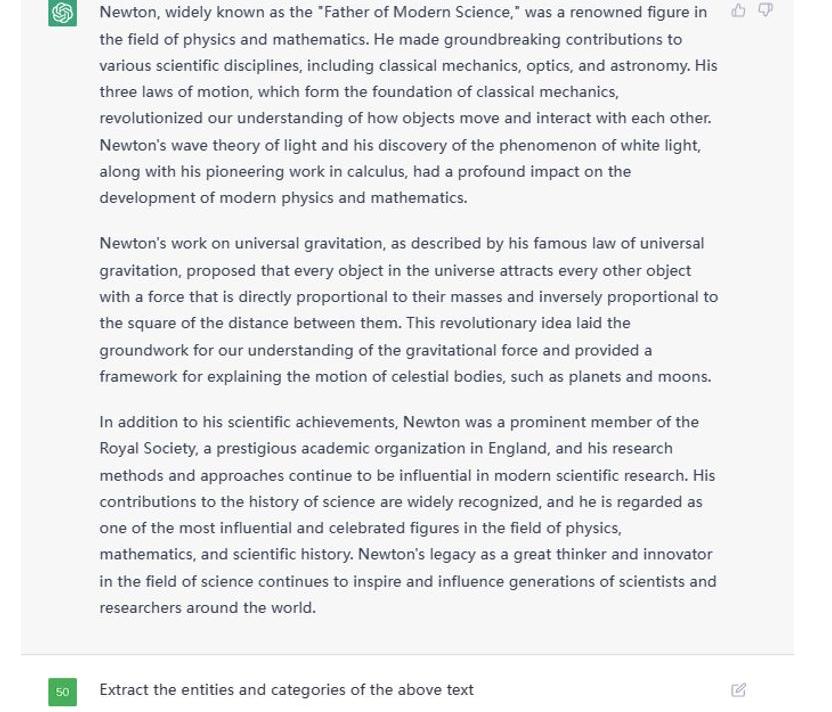

利用ChatGPT做实体识别与关系抽取轻而易举,例如给定一篇文本后,这么像它提问。

Figure4.ExampleTextGiventoChatGPT

这是部分结果截图:

Figure5.PartialOutputfromgivenTextonChatGPT

KIA美国发布以DASK系列NFT形象为主角的Soul车型广告:7月16日消息,KIA美国发布了其最新拍摄的2023款Soul(首尔)车型广告,本支广告以DASK(Dead Army Skeleton Klub)系列NFT形象为主角,目前KIA美国官方暂未透露更多信息。[2022/7/16 2:17:16]

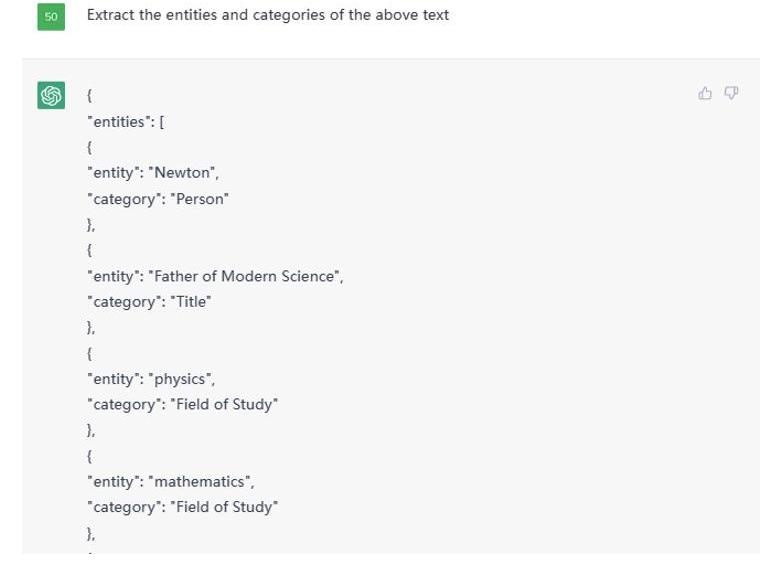

之后可以追问给他们的关系,例如:

Figure6.AskingrelationshiponChatGPT

这样,一个大型的知识图谱便可轻松建立。

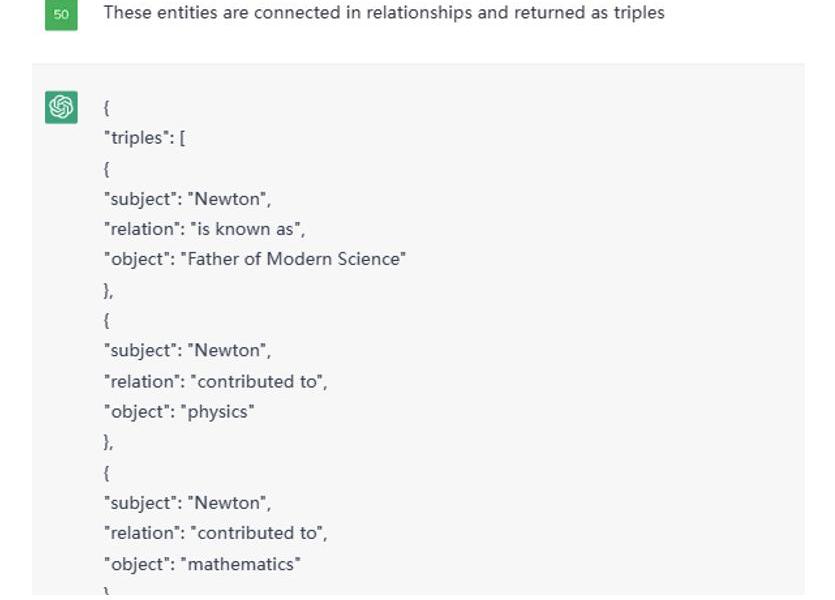

分析任务

如下图所示,我对ChatGPT提出了分析我目前需求的问题。

Figure7.ResultforneedsrequestonChatGPT

甚至还能让它给定分数。

Wrapped Cryptopunks系列NFT24小时地板价涨幅超250%:金色财经消息,据NFTGo.io数据显示,Wrapped Cryptopunks系列NFT总市值达1.466亿美元,24小时涨幅达268.32%,在所有NFT项目总市值排名中位列第18;其24小时交易额为78,426.48美元。截止发稿时,该系列NFT当前地板价为5.85ETH,24小时涨幅达251.25%。[2022/7/14 2:13:15]

Figure8.Scoringtoevaluatetheidentifiedneeds

除此以外还有数不胜数的方式,在此不一一列举。

组合Agent

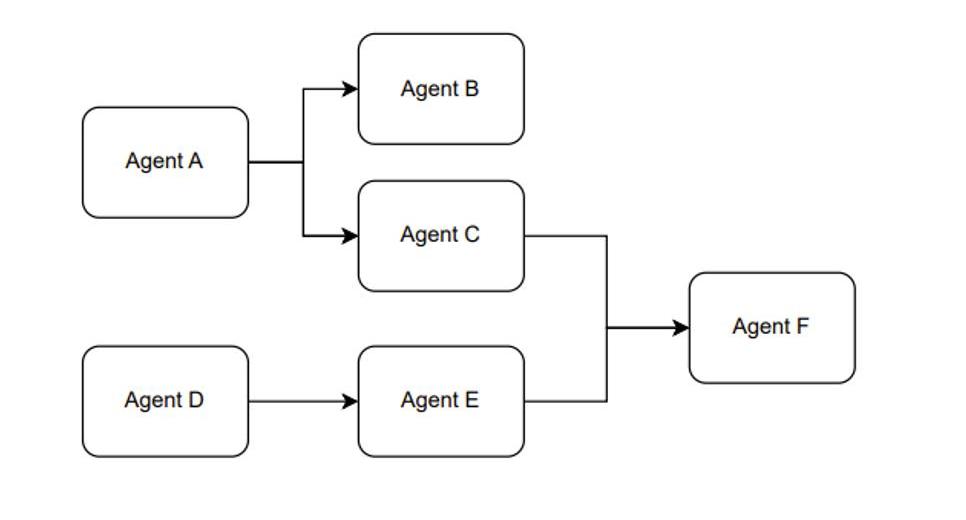

另外,我们在使用ChatGPT的API时,可以将不同的prompt模板产生多次调用产生组合使用的效果。我愿称这种使用方式叫做,组合Agent。例如Figure1展示的是一个大概的思路。

Figure9.?TheParadigmoftheCombinationAgent

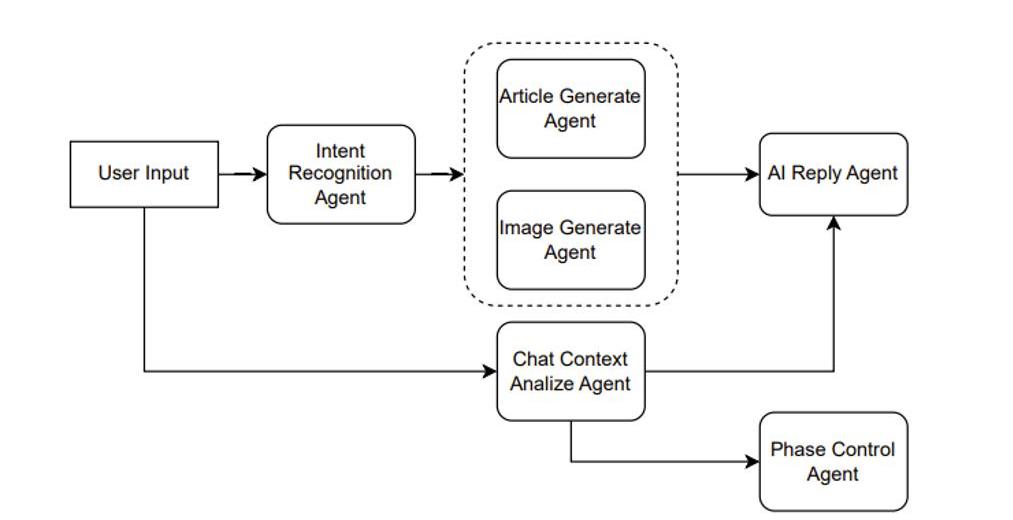

具体说来,例如是一个辅助创作文章的产品。则可以这么设计,如Figure10所示。

SpaceX确认“DOGE-1登月任务”遭遇延误:金色财经报道,据太空行业记者迈克尔·希茨(Michael Sheetz)在社交媒体披露,SpaceX首席执行官萨姆·里德 (Sam Reid)已经确认“DOGE-1 登月任务”的任务仍在进行但已遭遇延误,预计会于今年晚些时候进行,可能发射时间或在 2022 年 12 月。 作为支持狗狗币 (DOGE) 的一部分,马斯克于2021 年 宣布SpaceX 将在 2022 年与 Unizen、ZenX Labs 和能源技术公司 Geometric Energy Corporation 合作推出以狗狗币为主题的月球发射任务。[2022/7/2 1:46:18]

Figure10.Agentcombinationforassistingincreation

假设用户输入一个请求,说“帮我写一篇伦敦游记”,那么IntentRecognitionAgent首先做一个意图识别,意图识别也就是利用ChatGPT做一次分类任务。假设识别出用户的意图是文章生成,则接着调用ArticleGenerateAgent。

另一方面,用户当前的输入与历史的输入可以组成一个上下文,输入给ChatContextAnalyzeAgent。当前例子中,这个agent分析出的结果传入后面的AIReplyAgent和PhaseControlAgent的。

AIReplyAgent就是用来生成AI回复用户的语句,假设我们的产品前端并不只有一个文章,另一个敌方还有一个框用来显示AI引导用户创作文章的语句,则这个AIReplyAgent就是用来干这个事情。将上下文的分析与文章一同提交给ChatGPT,让其根据分析结果结合文章生成一个合适的回复。例如通过分析发现用户只是在通过聊天调整文章内容,而不知道AI还能控制文章的艺术意境,则可以回复用户你可以尝试着对我说“调整文章的艺术意境为非现实主义风格”。

PhaseControlAgent则是用来管理用户的阶段,对于ChatGPT而言也可以是一个分类任务,例如阶段分为等等。例如AI判断可以进行文章模板的制作了,前端可以产生几个模板选择的按钮。

使用不同的Agent来处理用户输入的不同任务,包括意图识别、ChatContext分析、AI回复生成和阶段控制,从而协同工作,为用户生成一篇伦敦游记的文章,提供不同方面的帮助和引导,例如调整文章的艺术意境、选择文章模板等。这样可以通过多个Agent的协作,使用户获得更加个性化和满意的文章生成体验。?

Prompt微调

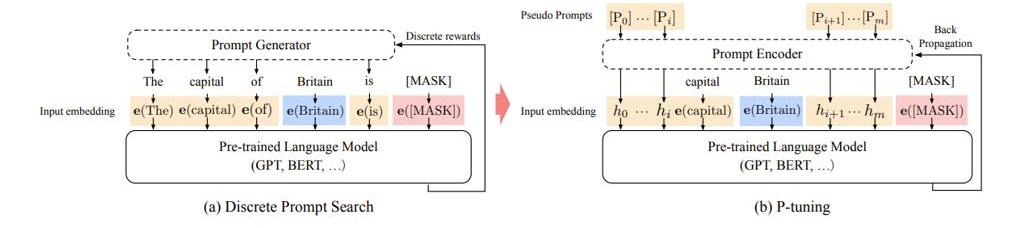

LLM虽然很厉害,但离统治人类的AI还相差甚远。眼下有个最直观的痛点就是LLM的模型参数太多,基于LLM的模型微调变得成本巨大。例如GPT-3模型的参数量级达到了175Billion,只有行业大头才有这种财力可以微调LLM模型,对于小而精的公司而言该怎么办呢。无需担心,算法科学家们为我们创新了一个叫做prompttuning的概念。

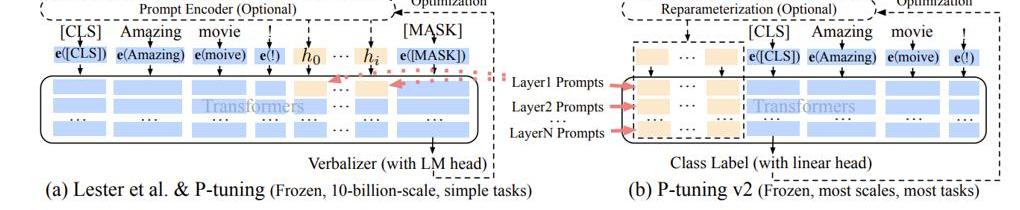

Prompttuning简单理解就是针对prompt进行微调操作,区别于传统的fine-tuning,优势在于更快捷,prompttuning仅需微调prompt相关的参数从而去逼近fine-tuning的效果。

Figure11.Promptlearning

什么是prompt相关的参数,如图所示,prompttuning是将prompt从一些的自然语言文本设定成了由数字组成的序列向量。本身AI也会将文本从预训练模型中提取向量从而进行后续的计算,只是在模型迭代过程中,这些向量并不会跟着迭代,因为这些向量于文本绑定住了。但是后来发现这些向量即便跟着迭代也无妨,虽然对于人类而言这些向量迭代更新后在物理世界已经找不到对应的自然语言文本可以表述出意思。但对于AI来讲,文本反而无意义,prompt向量随着训练会将prompt变得越来越符合业务场景。

假设一句prompt由20个单词组成,按照GPT3的设定每个单词映射的向量维度是12288,20个单词便是245760,理论上需要训练的参数只有245760个,相比175billion的量级,245760这个数字可以忽略不计,当然也会增加一些额外的辅助参数,但同样其数量也可忽略不计。

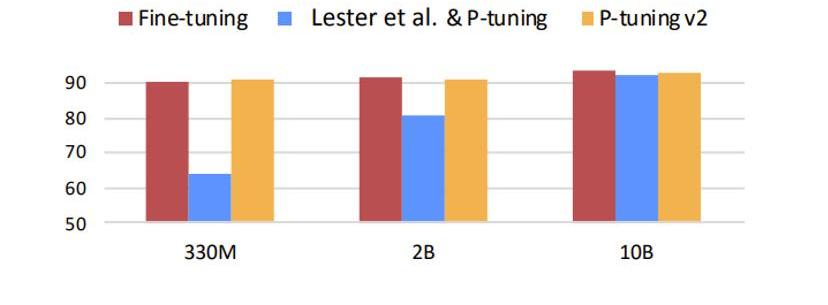

问题来了,这么少的参数真的能逼近?finetuning的效果吗,当然还是有一定的局限性。如下图所示,蓝色部分代表初版的prompttuning,可以发现prompttuning仅有在模型参数量级达到一定程度是才有效果。虽然这可以解决大多数的场景,但在某些具体垂直领域的应用场景下则未必有用。因为垂直领域的微调往往不需要综合的LLM预训练模型,仅需垂直领域的LLM模型即可,但是相对的,模型参数不会那么大。所以随着发展,改版后的prompttuning效果可以完全取代fine-tuning。下图中的黄色部分展示的就是prompttuningv2也就是第二版本的prompttuning的效果。

Figure12.Promptlearningparameters

V2的改进是将原本仅在最初层输入的连续prompt向量,改为在模型传递时每一个神经网络层前均输入连续prompt向量,如下图所示。

Figure13.Promptlearningv2

还是以GPT3模型为例,GPT3总从有96层网络,假设prompt由20个单词组成,每个单词映射的向量维度是12288,则所需要训练的参数量=96*20*12288=23592960。是175billion的万分之1.35。这个数字虽不足以忽略不计,但相对而言也非常小。

未来可能会有prompttuningv3,v4等问世,甚至我们可以自己加一些创新改进prompttuning,例如加入长短期记忆网络的设定。(因为原版的prompttuningv2就像是一个大型的RNN,我们可以像改进RNN一般去改进prompttuningv2)。总之就目前而言,prompttuning使得微调LLM变得可行,未来一定会有很多垂直领域的优秀模型诞生。

总结

LargeLanguageModels(LLMs)和Web3技术的整合为去中心化金融领域带来了巨大的创新和发展机遇。通过利用LLMs的能力,应用程序可以对大量不同数据源进行全面分析,生成实时的投资机会警报,并根据用户输入和先前的交互提供定制建议。LLMs与区块链技术的结合还使得智能合约的创建成为可能,这些合约可以自主地执行交易并理解自然语言输入,从而促进无缝和高效的用户体验。

这种先进技术的融合有能力彻底改变DeFi领域,并开辟出一条为投资者、交易者和参与去中心化生态系统的个体提供新型解决方案的道路。随着Web3技术的日益普及,LLMs创造复杂且可靠解决方案的潜力也在扩大,这些解决方案提高了去中心化应用程序的功能和可用性。总之,LLMs与Web3技术的整合为DeFi领域提供了强大的工具集,提供了有深度的分析、个性化的建议和自动化的交易执行,为该领域的创新和改革提供了广泛的可能性。

标签:ROMOMPPROMPROPhotoChromicCompound币圈prom币23年可以买吗FIO Protocol

原文来源|Lukasinho@GCR原文编译|白泽研究院Web3近年来发展迅速,对可扩展解决方案的需求变得更加迫切.

1900/1/1 0:00:00别在瞎冲了,一文读懂爆火出圈的BRC-20到底是个啥?BRC-20代币标准是由@domodata在2023年3月8日创建的比特币实验性的同质化代币标准.

1900/1/1 0:00:00人们普遍认为,以太坊上海升级将是一个“卖出新闻”的事件。尽管这并没有立即起到催化作用,但市场已经开始走低。有些人认为我们会看到大量的验证者取消质押并出售其ETH.

1900/1/1 0:00:00Pendle在TVL/币价双双实现十倍涨幅后,飞轮增长也即将启动。作为一个使用ve-tokenomics的代币,其尚且缺乏一个Convex来充分发挥其潜力.

1900/1/1 0:00:00本文为以太坊上海升级共学系列活动中,Patrick与肖风线上对话的文字内容。Patrick:我们今天和众多DAO组织准备了这样一个上海升级的系列活动.

1900/1/1 0:00:00注:本文来自@jolestar推特,MarsBit整理如下:Web3到底有没有0香港Web3大会期间,看到网上又开始讨论Web3和Web3.0的区别.

1900/1/1 0:00:00